AI 和音乐的结合已经成为一个新兴的行业,AI 编曲的《Free Break》风靡一时,它的成功,在于“AI+HI”的合作。

这首歌的编曲是由一家名为 Amper 的公司的 AI 完成的。此前,Amper 曾经宣布融资 400 万美元,开始做 AI 谱曲编曲的项目。当时,Amper 的项目主要还是被当作一个能够快速产出相对低成本且不涉及版权问题的“功能性”音乐,比如广告或网络短片配乐。而此次 Amper AI的惊艳表现显然已超出了对它的原有预期。

Amper Music 的联合创始人Drew Silverstein 表示,公司的核心之一是,未来的音乐一定是人类和 AI 共同创造的。想做到这一点,就需要计算机“在本质上就具有创造性”。他认为,正是创造力,才让 Amper 如此独特。

当然,他也认同,目前计算机还没达到给出创造性的、突破性的想法的阶段。Amper 最擅长的,正是和人类合作。这也是为什么在这首风靡网络的Free Break 中,AI 扮演的是编曲的角色,而作词作曲和演唱都由人类担纲。

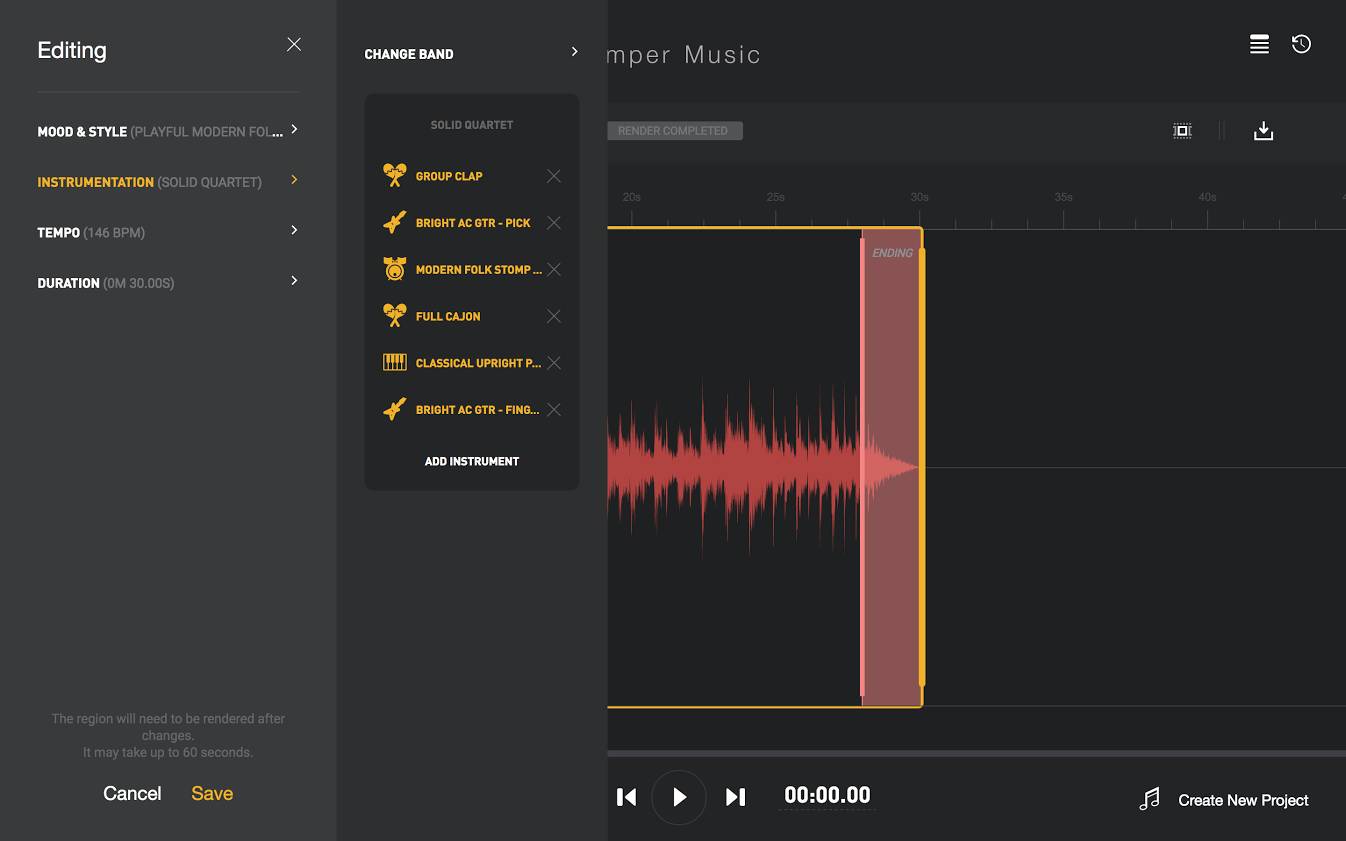

如果想利用 Amper 创作一条音轨,你只需要确定情绪、长度和体裁,在几秒钟之内,你就会得到一首曲子(创作时间随着曲子时长的增加而增加),然后你可以精修它,比如增加或去掉某些乐器。

Amper Music 是索尼音乐和华纳音乐部分出资成立的创业孵化公司 Techstars Music 的孵化项目,该公司的另一个孵化项目叫做 Popgun。

AI 和音乐的结合,这是一个新兴的行业。除了互联网巨头比如 Google 的 AI 音乐研究项目 Magenta 以及索尼在巴黎的 Flow Machines 之外,这个行业的新起之秀也不少,包括在伦敦的 Jukedeck、在的 Melodrive,在的 Humtap 以及在 Google 老家山景城的 Groov.AI。

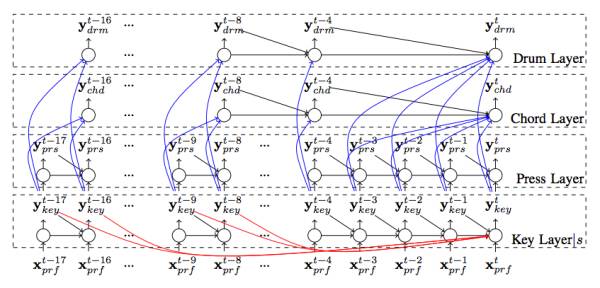

我们提出了一个生成流行音乐的新框架。我们的模型是层次循环神经网络,层和结构中编码了关于流行音乐如何构成的先验知识。具体来说,底层生成旋律(melody),较高层生成节奏与和弦。我们进行的实验表明,与用谷歌最近的方法生成的音乐相比,人类受试者明显更偏爱我们生成的音乐。另外,我们还展示了新框架的两种应用:神经舞蹈和卡拉OK,以及神经歌谣。

知乎上,深度学习(Deep Learning)、机器学习、人工智能话题的优秀回答者周博磊曾对该论文做过介绍。他说:“论文的大致想法是利用深度学习的LSTM模型(hierarchical recurrent network),利用100个小时的流行歌曲的 mini 格式的 tag 进行训练。这里比较有意思的地方是作者在这个模型里面整合了一些音乐相关的general knowledge,模型结构如下图所示,在RNN这个模型中有key layer, press layer, chord layer, drum layer 等结构,在模型设计和合成的过程中也考虑了 scale 和 chord 等音乐因素。这些 prior 无疑可以更好的帮助人工智能模型学习音乐中的关键元素以及常见套。”(链接:)

周博磊还说:“论文里面还展示了一些应用,比如说生成音乐的过程中同时生成跳舞的(如下图),以及尝试用 neural image captioning的办法生成歌词或者朗诵,这些应用都给未来提出了无限可能性。”返回搜狐,查看更多

推荐: